사진. 광주과학기술원

광주과학기술원은 AI융합학과 이규빈 교수 연구팀이 실제 환경의 복잡성을 정밀하게 반영한 세계 최대 규모의 로봇 파지(Grasp, 집기) 데이터세트 ‘그래스프클러터6D(GraspClutter6D)’를 구축·공개했다고 밝혔다.

기존 로봇 AI가 단순하고 정돈된 상황에서만 제한적으로 작동했던 한계를 넘어, 물체가 뒤엉킨 현실 환경에서도 안정적으로 동작하는 ‘로봇 파운데이션 모델*’ 구축의 핵심 기반을 마련하고, 최근 전 세계적으로 주목받고 있는 ‘피지컬 AI(Physical AI)’ 연구 발전에도 크게 기여할 것으로 기대된다. 이번 연구는 한국기계연구원(KIMM)과의 협업으로 수행됐다.

로봇이 물체를 집는 동작은 가장 기본적이면서도 어려운 과제 중 하나다. 특히, 창고에서 물건을 꺼내거나 가정에서 물건을 정리하는 상황처럼 물체가 겹치고 가려진 현실에서는 로봇이 물체를 정확히 인식하고 안정적으로 집기 어렵다.

최근 딥러닝 기술의 발전으로 로봇의 집기 성능이 크게 개선됐지만, 지금까지의 학습용 데이터세트는 주로 정돈되고 단순한 환경을 전제로 하고 있어 실제 환경 적용에는 한계가 있었다. 그 결과, 여러 물체가 뒤엉켜 있거나 배경이 다양한 실제 상황에서는 로봇의 성능이 급격히 저하되는 문제가 나타났다.

예컨대 전 세계적으로 널리 활용되는 데이터세트 ‘그래스프넷-원빌리언(GraspNet-1Billion)*’의 경우, 한 장면당 평균 물체 수가 9개 미만이고 가려진 비율도 약 35%에 불과해 실제 현실을 충분히 반영하지 못한다.

연구팀은 이러한 한계를 극복하기 위해 실제 생활·산업 환경을 정밀하게 재현한 초대형 데이터세트 ‘GraspClutter6D’를 구축했다.

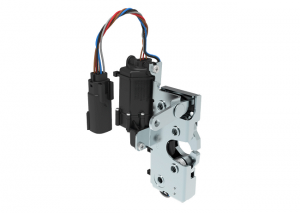

연구팀은 상자·선반·탁자 등 75가지의 다양한 환경을 구성하고, 로봇팔에 RGB-D(컬러+깊이) 카메라* 4대를 장착해 총 1,000개 장면에서 5만 2천 장의 이미지를 수집했다.

데이터세트에는 ▴실제 물체 200종의 고품질 3D 모델 ▴73만 6천 개의 6차원(D) 물체 자세* ▴93억 개에 달하는 로봇의 6차원(D) 파지 자세*가 포함돼 있다. 이는 기존 공개 데이터세트를 압도하는 규모다.

연구팀은 데이터세트와 함께 최신 AI 인식·파지 모델의 성능을 평가한 벤치마크 결과도 공개했다.

▴최신 객체 분할 ▴6차원 자세 추정 ▴집기 검출 방법을 평가한 결과, 물체가 많이 겹치고 복잡한 환경에서는 기존 AI 기술의 성능이 크게 저하되는 것으로 나타났지만, ‘GraspClutter6D’ 데이터세트로 학습한 AI 모델은 실제 로봇 물체 집기 실험에서 뚜렷한 성능 향상을 보였다.

단순 환경(5개 물체)에서는 집기 성공률이 77.5%에서 93.4%로 15.9%p로 향상됐고, 복잡한 환경(15개 물체)에서는 54.9%에서 67.9%로 13.0%p 개선됐다.

이는 ‘GraspClutter6D’가 단순히 규모가 큰 데이터세트가 아니라, 실제 환경을 충실히 반영한 ‘현실성 있는 데이터세트’임을 입증한다.

이규빈 교수는 “이번 성과는 산업 환경과 가정에서 마주치는 복잡한 상황을 최초로 충실히 재현했을 뿐만 아니라, 로봇이 현실 세계에서 학습하고 행동하는 것을 목표로 하는 피지컬 AI 연구에도 중요한 기반을 제공한다”며, "향후 물류, 제조, 생활 서비스 등 다양한 분야에서 로봇 활용을 한 단계 도약시킬 수 있을 것”이라고 말했다.

‘GraspClutter6D’와 관련 도구는 공개 웹사이트*에서 전 세계 연구자들에게 무료로 제공되며, 이를 통해 누구나 로봇 집기 연구와 6차원 물체 자세 추정, 범용 로봇 파운데이션 모델 학습 등에 활용할 수 있다.